Letzte Aktualisierung am Oktober 23, 2025

Estimated reading time: 3 Minuten

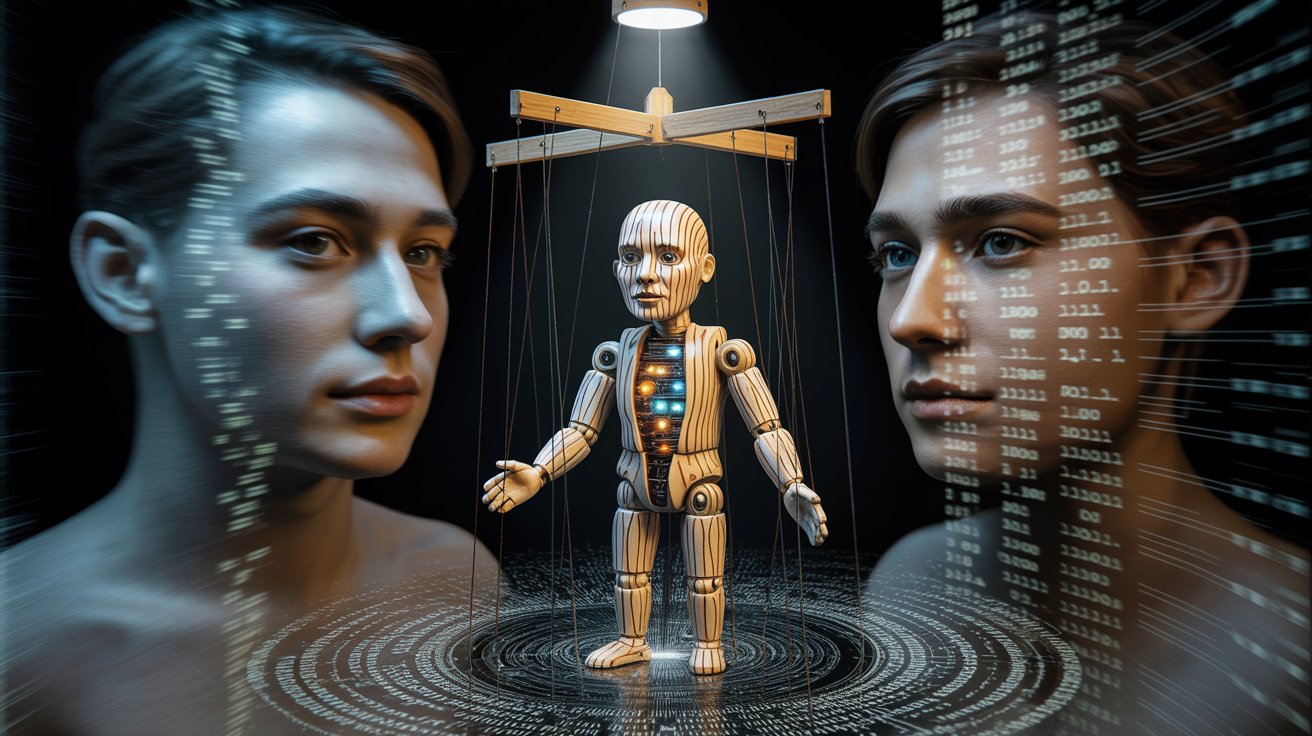

Künstliche Intelligenz ist längst kein Zukunftsthema mehr. Sie ist allgegenwärtig – in Werbespots, in Social Media, in Suchmaschinen, in Musik- und Video-Apps. Systeme wie ChatGPT, Midjourney oder Sora erzeugen Inhalte, die so real wirken, dass sich Realität und Simulation kaum noch unterscheiden lassen. Die Flut an KI-generierten Bildern, Texten und Videos wächst täglich. Doch was bedeutet das für unsere Wahrnehmung, unsere Entscheidungsfreiheit – und letztlich für unsere Kontrolle?

Eine digitale Welle

Kaum ein Tag vergeht, ohne dass ein neuer KI-Dienst angekündigt wird, der angeblich „alles einfacher“ macht. Ob Texte, Präsentationen, Musik oder ganze Filme: Alles soll jetzt KI-gestützt funktionieren. Unternehmen nutzen diesen Hype gezielt, um Produkte zu vermarkten. „Mit KI“ ist heute ein Verkaufsargument – ähnlich wie „Smart“ oder „Bio“ in früheren Jahren.

Hinzu kommt die algorithmische Verstärkung: Soziale Netzwerke wie TikTok, Instagram oder YouTube belohnen Inhalte, die überraschen und faszinieren. KI-generierte Videos sind genau das – spektakulär, neuartig, manchmal auch verstörend. Der Effekt: Unser Feed wirkt, als bestünde die Welt nur noch aus künstlicher Intelligenz.

Kontrolle oder Bequemlichkeit?

Das zentrale Problem liegt weniger in der Technologie selbst, sondern in unserer Haltung dazu. KI wird uns nicht zwingen, sie zu benutzen – sie macht es nur extrem bequem, es zu tun.

Wenn Chatbots Texte schneller schreiben, Bildgeneratoren Werbung billiger produzieren und VideokIs ganze Kampagnen automatisieren, entsteht ein gefährlicher Komfort: Wir geben Kontrolle ab, ohne es zu merken.

Dabei geht es nicht nur um Arbeitsprozesse, sondern auch um Wahrnehmung. Wer täglich KI-Inhalte konsumiert, deren Herkunft nicht mehr nachvollziehbar ist, verliert den Bezug zur Realität. Was ist echt, was ist generiert? Was ist Meinung, was ist optimierter Output?

Manipulation durch Präzision

Eine weitere Gefahr ist die gezielte Beeinflussung durch KI-gestützte Systeme. Werbedienste, soziale Netzwerke oder Nachrichtenseiten nutzen immer genauere Profile, um Inhalte individuell zuzuschneiden. Was früher „Zielgruppen-Marketing“ hieß, ist heute personalisierte Manipulation – optimiert durch maschinelles Lernen.

KI kann Botschaften emotional aufladen, Reaktionen vorhersagen und Verhalten steuern. Das geschieht nicht böswillig, sondern aus wirtschaftlichem Interesse. Doch der Effekt bleibt derselbe: Menschen treffen Entscheidungen, deren Ursachen sie kaum noch nachvollziehen können.

Chancen nutzen, Risiken erkennen

Trotz aller Kritik darf man die positiven Seiten nicht übersehen. KI kann helfen, Prozesse zu vereinfachen, Barrieren zu überwinden, medizinische Forschung zu beschleunigen und kreative Ideen zu erweitern. Entscheidend ist, wie wir sie einsetzen.

Die Gesellschaft muss lernen, künstliche Intelligenz zu verstehen – nicht als Ersatz für menschliches Denken, sondern als Werkzeug. Dazu gehören Transparenz, klare Kennzeichnung von KI-Inhalten und Bildung im Umgang mit Algorithmen.

Fazit

Die eigentliche Gefahr besteht nicht darin, dass Maschinen uns überholen, sondern dass wir das Denken an sie delegieren.

Künstliche Intelligenz ist mächtig – aber sie sollte Werkzeug bleiben, nicht Weltbild.

Ob wir die Kontrolle behalten oder verlieren, hängt weniger von der Technologie ab als von unserem eigenen Bewusstsein.

https://letscast.fm/sites/der-it-blog-1fb4aba7/episode/kontrolle-oder-beeinflussung-unseres-denkens

Sei der Erste, der das kommentiert

Kommentare sind geschlossen, allerdings sind Trackbacks und Pingbacks möglich.